近年、ChatGPTをはじめとするAIチャットツールがビジネスの現場でも急速に活用されるようになってきました。

「議事録の自動作成」「顧客対応の効率化」「社内Q&Aの自動化」など、その用途は多岐にわたり、導入を検討する企業も少なくありません。

しかし一方で、「情報漏洩のリスクは?」「本当に安心して使えるのか?」「社内でどう運用すべきか?」といった不安や疑問の声も多く聞かれます。

今回は、ChatGPTを企業で導入する際に知っておくべきポイントや、注意すべきリスク、そして安全に導入・活用していくためのヒントをわかりやすく解説します。

ChatGPT導入のメリットとは?業務効率アップに役立つ活用例

ChatGPTは、営業職や事務職を中心に、日常業務の効率化をサポートするツールとして注目されています。

ここでは、特に活用されやすい4つの具体例と、その導入イメージをご紹介いたします。

① メールや報告書のひな型作成など、文章系業務の効率化

ChatGPTは、自然な文章を瞬時に作ってくれるため、業務メールや議事録、報告書などの「たたき台(ひな型)」作成にとても便利です。

例えば、お礼メールやご案内メールの下書き、定型的な社内連絡文など、ChatGPTに目的やトーンを伝えるだけで、適切な文章を提案してくれます。「ゼロから考える負担」が大きく減るのが魅力です。

② 手順書や社内マニュアルの作成にも活用できる

ChatGPTは「情報を整理して、わかりやすく伝える」のが得意です。そのため、社内向けの手順書やマニュアルのドラフト作成にも向いています。

たとえば、業務フローの文章化、新人研修用の説明資料のたたき台など、口頭では伝えにくい手順やルールを、ChatGPTがわかりやすい形に整えてくれるため、情報共有や業務の属人化防止にもつながります。

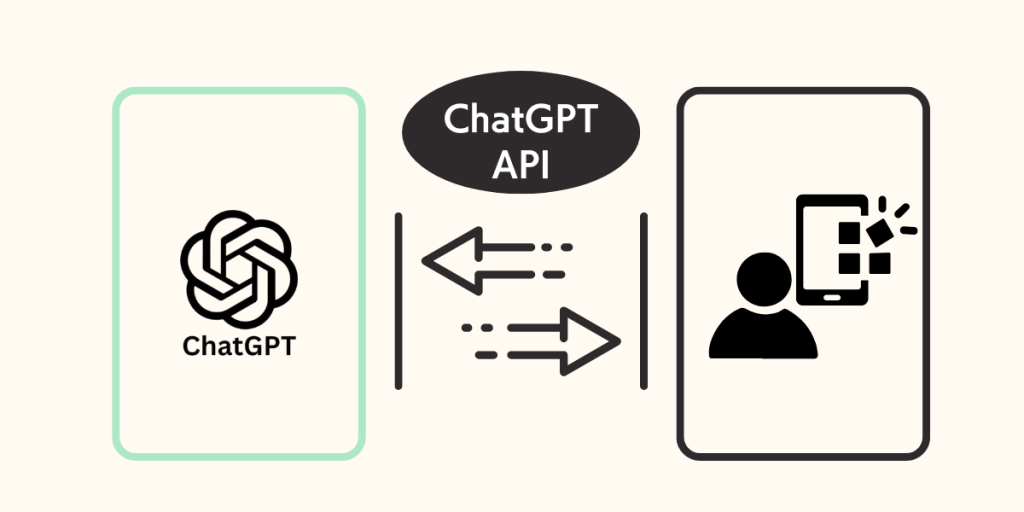

③ ChatGPTと他ツールの連携で、顧客対応も自動化できる

最近では、ChatGPTを単体で使うだけでなく、他のツールと組み合わせて使う活用法も増えてきました。

たとえば、社外向けのQ&A自動応答ツールや、社内チャットボットの中核としてChatGPTを組み込む事例です。

・ホームページ上のチャットボットにChatGPTを連携

・NotionやSlackと連携し、社内問い合わせ対応を自動化

・顧客サポートの一次対応にChatGPTを導入

このように、ChatGPTは「文章生成AI」からさらに進化し、業務の一部を自動化する仕組みとしても活躍しています。

ChatGPT導入で企業が注意すべきポイント

情報漏洩のリスクとは?

ChatGPTを使う際に注意したいのが「情報漏洩」のリスクです。情報漏洩とは、本来外部に出してはいけない情報が、意図せず外に出てしまうことを指します。

リスク①:入力した情報がAIに学習されてしまう

ChatGPTを始めとしたAIツールでは、AIの回答を改善するために、ユーザーとの会話内容がAIの学習に利用されることがあります。

たとえば、開発中の製品情報や設計図、取引先の名前や担当者名、社内用の手順書など、企業にとって大切な情報を入力してしまうと、AIがその内容を「学習」して記憶に残してしまうことがあります。

実際に、韓国のSamsung社では、社員が開発中のコードをChatGPTに入力したことがきっかけで、機密情報が外部に漏れるリスクがあるとして、社内利用が問題視された事例があります。

2023.05.03 Forbes JAPANより引用

「サムスン、ChatGPTの社内使用禁止 機密コードの流出受け」

https://forbesjapan.com/articles/detail/62905

そのため、AIを利用する際は「社外秘の情報を入力しない」「学習への利用を禁止する設定に切り替える」といったリスクマネジメントが大切です。

リスク②:他のユーザーに自社情報が表示されることがある

ChatGPTは、より良い回答を返すために、過去に他の人が入力したデータを学習材料としています。そのため、自分が入力した内容が、まったく関係のない別のユーザーの画面に出てしまうこともあるのです。

このような現象は「リバースプロンプト」とも呼ばれ、たとえば自社の見積もり金額や商品仕様のような情報が、ほかのユーザーの質問に対する回答の一部として表示されてしまう、という報告もあります。

これは、情報が漏れたという自覚がないまま、第三者に重要な情報が伝わってしまう可能性がある、非常に厄介なリスクです。

リスク③:社員の操作ミスによる誤入力や誤送信

ChatGPTに関連する情報漏洩の中で、特に多いのが「操作ミス」などの人為的なトラブルです。

たとえば、顧客リストを間違って貼り付けたまま送信してしまったり、誤って社外と共有されているリンクを使ってしまったり、AIが生成した内容を確認せずにそのまま社外に送ってしまう、というケースが起きています。

こうしたヒューマンエラーは、特に操作に慣れていない社員や、多忙な現場で起こりやすい傾向があります。技術的な対策だけでは防ぎきれないため、社内での意識づけや教育も非常に重要です。

情報漏洩を防ぎながら活用するコツ

ここまでご紹介してきたように、ChatGPTを業務に導入する際には、情報漏洩のリスクがあることを正しく理解しておく必要があります。とはいえ、「だからAIは使わないほうがいい」ということではありません。

実際には、多くのリスクはちょっとした工夫やルールづくりによって、十分に防ぐことが可能です。ここでは、情報漏洩を防ぎながらChatGPTを上手に活用するためのコツをご紹介します。

①社内ガイドラインをつくる

まず最初に行いたいのが、ChatGPTの利用に関するルールづくりです。

「どこまでの情報なら入力してもよいのか」「どんな用途に限定して使うのか」などを明確に定めておくことで、社員が迷わず安全に活用できるようになります。

たとえば、「顧客情報や個人名は入力しない」「社内文書の下書き作成・要約などに限定」といったガイドラインを決めておくだけでも、情報漏洩を防ぐ効果があります。

②利用状況を「見える化」する

情報漏洩のインシデントの多くは、「誰が、いつ、どんな内容を入力したのかがわからない」ことが原因で、早期対応ができなかったというパターンです。

そのため、ChatGPTの利用履歴をログとして記録したり、社内専用アカウントを作成して運用するといった仕組みが必要になります。

特に、社内で複数人が使う場合は、アカウント個数・利用者などの情報を管理者側で把握できるようにしておきましょう。

③有料版やAPI版の導入を検討する

ChatGPTは、無料版でも設定を変更することで、入力内容がAIの学習に使われないようにすることができます。個人での利用や試験的な活用であれば、まずは無料版から始めるのも良い方法です。

一方で、業務の中にしっかりと組み込んでいきたい場合や、複数の社員で共有しながら使いたいといった場面では、有料プラン(Team版・Enterprise版)やAPI版の導入を検討することをおすすめします。

これらのプランでは、利用者ごとのアクセス管理や履歴の追跡、他の業務ツールとのスムーズな連携などが可能になり、企業として安心して運用するための仕組みが整っています。

特に、日常的にChatGPTを使いたい企業様や、社内全体での活用を考えている場合には、こうしたビジネス向けプランの活用が有効です。

④社員教育と定期的な研修も重要

どれだけルールやシステムが整っていても、実際に使うのは「人」です。

そこで、ChatGPTの使い方やリスクについて定期的に社内で共有することが、インシデントを防ぐ大きなカギとなります。

新入社員向けの研修だけでなく、定期的に全社員に向けて「注意すべきポイント」や「事例の共有」などを行うことで、リスクへの意識が高まり、安全な運用につながります。

もし不安がある場合は外部サポートを活用しよう

AIツールの導入に興味はあるけど、「技術的な設定が難しい」「教えられるIT担当がいない」とお悩みの企業も多いはず。

そういった場合は、社内研修として、AI導入支援やITコンサルの検討が必要となります。

株式会社沖縄電子の「AI導入支援」とは?

沖縄電子は、防犯カメラや無線機、ITセキュリティ機器などを中心に、沖縄県内の企業様へ安心と信頼のITサービスを提供している会社です。

近年ではAIやクラウドツールの導入支援も強化し、

「地元企業のDX(デジタル化)を応援するパートナー」として、定期的にAI導入支援のセミナーなどを開催しています。

導入前の無料相談も受付中

「うちの業務で使えるか不安…」「セキュリティが心配…」という段階でも、ぜひお気軽にご相談ください!弊社での実際の活用事例などをご紹介しつつ、IT担当者よりお悩みに合わせたご提案をさせていただきます。

【ご提案できるAIツール例】ChatGPTの基本的な利用方法・外部ツールとの連携・自動化、Notionを利用した社内タスク管理など

まとめ

ChatGPTは業務効率化に大きな効果がある一方で、機密情報の管理や回答の精度、著作権・社内ルール整備など注意すべき点も多くあります。

導入の際には、小規模な業務から始め、社内での使い方ルールや研修を整備することが大切です。

不安がある場合は、外部の専門家と連携して、安全に導入・運用していくのが安心です。

AIを“怖がって避ける”のではなく、“正しく使って味方にする”ことが、これからの企業成長にとって重要なカギになるでしょう。